Troisième billet d’une série consacrée aux plateformes DMP.

Dans le premier billet de cette série consacrée aux plateformes DMP, on avait défini quelles sont les données classiquement utilisées dans une DMP, et on avait rapidement donné la définition des 3 principaux types de données dans une DMP :

– First Party Data

Les données First Party sont toutes les données qu’une marque ou un annonceur va pouvoir collecter du fait d’une interaction directe avec un individu : via une visite sur le site web de la marque, via l’utilisation d’une appli mobile, via une commande en ligne, via un achat ou la souscription à un abonnement, mais aussi via des contacts « offline » (programmes de fidélisation, couponing, etc.) dont les données se retrouvent généralement dans les bases CRM de la marque.

– Second Party Data

Les données 2nd Party sont essentiellement des données collectées sur des sites web qui n’appartiennent pas à la marque, mais qui sont ceux de sociétés ou d’acteurs avec lesquels la marque aura conclu des accords de partenariat spécifiques comportant un accord – financier ou non – sur l’échange ou le partage de données.

Je consacrerai un prochain billet spécifiquement au sujet des données 2nd Party et à l’importance de mener une réflexion en profondeur sur ce sujet dans le cadre d’un projet DMP.

– Third Party Data

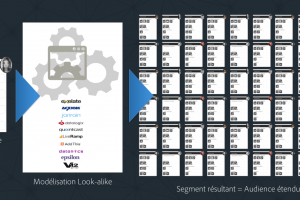

Enfin, les données Third Party, qui sont collectées et fournies – généralement vendues ou plutôt louées à l’acte et au CPM – par des tiers spécialisés, tels que Acxiom, AddThis, Eyeota, eXelate, VisualDNA, pour ne citer que quelques noms.

Dans les DMP, les données 3rd Party sont généralement accessibles via une marketplace de données, dans laquelle les marketeurs peuvent explorer ces données, observer leur recouvrement ou au contraire leur distance avec leurs propres données et activer ces données, selon leurs besoins et leurs objectifs.

Continue reading “DMPSeries #3 – Données 1st Party vs données 3rd Party”