TL;DR

- Les solutions d’Analytics sont au fil du temps devenues très puissantes, mais aussi très complexes

- En entreprise, l’exploitation de l’analytics et du web analytics reste basique, voire parfois quasi inexistante

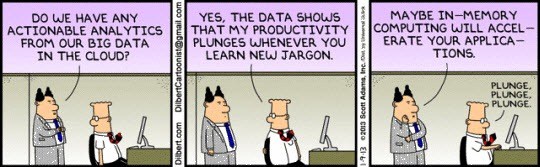

- Les éditeurs de solutions vendent l’idée que l’IA couplée aux outils de marketing permet d’obtenir des résultats sans besoin d’injecter de l’intelligence humaine

- En l’absence d’intelligence humaine, les solutions de Predictive Analytics sont elles aussi vouées à l’échec

Intro

2017 : c’est année des bots et de l’IA. En résumé, ce qu’on entend quasiment quotidiennement, c’est : « Si tu n’utilises pas d’intelligence artificielle ou du machine-learning pour piloter ton business, tu vas rater ta target. »

Et si on avait un doute, les éditeurs de suites marketing enfoncent le clou et nous parlent tous les jours de leurs intelligences artificielles maison.

Chez IBM, les technologies cognitives s’appellent collectivement « Watson ». Chez Salesforce, on nous parle de « Einstein » – pas besoin de sortir de Polytechnique pour comprendre que Einstein c’est quelqu’un de beaucoup plus intelligent que nous.

Chez Adobe, c’est « Sensei », ce nom inspire plus la confiance envers un Maître dont les oracles (no pun intended) sont parfois difficiles à interpréter pour un mortel, mais ne devraient jamais être remises en cause :)

Qu’est-ce que le Predictive Analytics ?

Plus sérieusement, le Predictive Analytics, c’est un ensemble de technologies utilisant des données, des algorithmes statistiques et de machine-learning en vue de déterminer la probabilité de l’occurrence de faits futurs par l’observation de faits et données passées.

On pourrait préciser un peu plus en disant qu’il existe deux grandes catégories : les algorithmes purement statistiques et utilisant diverses sortes de régressions sur des ensembles de données temporelles, et une autre catégorie basée sur les techniques de machine-learning (réseaux de neurones, deep-learning, etc.).

Predictive Analytics : une idée nouvelle ?

Non. L’idée n’est pas nouvelle. Simplement de nos jours elle s’appuie sur le big data et le machine-learning.

Il y a 30 ans de cela, en 1986, alors que j’étais encore étudiant, j’étais en stage chez IBM dans l’entrepôt de préparation de commandes entièrement robotisé de Evry-Lisses, et j’avais travaillé sur un logiciel collectant des données liées au fonctionnement, anomalies et pannes de divers équipements à des fins de maintenance préventive. Par exemple, un chariot autonome filoguidé sur lequel on constatait un nombre d’anomalies de pertes de signal de guidage en augmentation hors-normes, était sorti de la ligne de production et envoyé en maintenance avant d’avoir causé une panne plus profonde, voire une interruption de toute la ligne.

Plus récemment, vers 1997 j’étais en mission à Evry dans la biscuiterie Belin-LU où le service marketing avait développé un système de prévision des ventes, collectant des données de remontée de tickets de caisse afin de prévoir les ventes par produit, famille de produit, quantités et conditionnement afin de piloter les unités de production. Les biscuits sont fragiles et ont des DLC courtes. Produire de grosses quantités à l’aveuglette sans avoir une idée des niveaux de demande à venir, c’est assurément aller vers des volumes de retours massifs, et de la perte de bénéfices – sans même parler du gâchis de matières alimentaires.

Egalement, on a toutes et tous déjà entendu parler de GFT : Google Flu Trends. Or, même pour Google, ça n’était visiblement pas aussi facile que la légende le disait : Le service a fermé en 2015.

Bref, assez d’histoire ancienne…

Le Predictive Analytics qui marche

Mon propos ici n’est pas de dénigrer tout le domaine du Predictive Analytics. Il est des domaines – comme celui évoqué précédemment lié à la maintenance préventive des équipements et matériels – qui fonctionnent et donnent de bons résultats. Dernièrement, la SNCF a annoncé utiliser des technologies IBM Watson sur ces mêmes problématiques.

Marketing et Predictive Analytics

En revanche, il y a un domaine du Predictive Analytics pour lequel j’ai une approche, disons, plus nuancée, voire carrément critique. C’est le domaine du Predictive Analytics lié aux données marketing et appliqué au marketing digital.

Il est effarant de constater le nombre d’entreprises, de marques et de business de tous types, dans lesquels la culture de la donnée est encore quasi inexistante, et cela à tous les niveaux : on réalise des campagnes d’affichage en extérieur sur des affiches 4×3 ou sur du mobilier urbain mais… on n’a mis en place aucun processus pour récupérer de la donnée de tickets de caisse afin d’évaluer l’impact de la campagne sur les ventes. Ou bien on a encore des approches de campagnes marketing Print / Online / Social / etc qui sont totalement en silos, sans cohérence et sans aucun souci de répartition ou d’optimisation en fonction de l’attribution des ventes à ces points de contact. Les budgets sont pilotés par des services différents. Ou bien, encore, et de façon plus classique : on a bien mis en place une solution de Web analytics – gratuite ou payante, peu importe à ce niveau – mais on ne fait quasiment aucune exploitation des données collectées, et les rapports produits en sont encore quasiment du niveau « nombre de visiteurs uniques / nombre de pages vues ». Nous sommes en 2017.

Ce nom de « Web analytics » est un terme très réducteur, et quasiment plus adapté. Les plus avancées de ces solutions permettent de nos jours en plus des données d’activité sur les sites web de croiser les chiffres du mobile, mais aussi d’y injecter des données et attributs provenant de votre CRM, afin de pouvoir affiner les analyses. Les outils d’Analytics donc sont devenus très complets, et très puissants.

Trop, peut être ?

Concrètement, qui dans votre organisation sait se connecter à votre solution Analytics, sait identifier les données intéressantes, peut produire un rapport ad-hoc permettant de comparer les comportements de deux cohortes distinctes ou pourrait analyser les causes d’un pic de trafic en anomalie ?

Cherchez bien. Peu de gens, certainement. Personne, parfois.

Predictive Analytics : le cache-sexe de la donnée

J’imagine qu’à un moment, les grands éditeurs de suites marketing ont été lassés de créer des solutions de plus en plus puissantes, mais de moins en moins bien utilisées par leurs clients. C’est le paradoxe de ces solutions devenues tellement puissantes qu’elles ont développé un côté si intimidant que finalement peu d’entreprises sont en mesure de les exploiter correctement, et n’en ont finalement qu’une utilisation basique.

Or, parmi ces clients ne réalisant pas la valeur de la solution qu’ils s’étaient offerts, certains étaient tentés de basculer vers le gratuit « good enough » au moment de renouveler le contrat : passer à Google Analytics Standard. Pour suivre leur business. Comme s’il s’agissait de leur blog perso. En 2017.

Alors, depuis, les éditeurs ont compris la leçon et face à l’alternative entre produire des solutions très puissantes mais complexes, ou bien tenter de simplifier à outrance au risque de produire des outils simplistes, ils ont ouvert une troisième voie : celle de l’intelligence artificielle et du Predictive Analytics.

Avec Watson, Einstein et autres Sensei, c’est la promesse de plateformes intelligentes, qui sont capables de faire automatiquement tout le travail d’analyse, de diagnostic voire de poser les actions correctives et de lancer les activations, de façon automatique, et sans aucun besoin d’intelligence humaine.

Bingo. L’argument fait mouche. Le Predictive Analytics est un must have.

Ce que certains ont oublié, c’est que, peu importe les souches algorithmiques de ces solutions (statistiques, machine-learning, etc.), elles ont besoin de données en quantité afin de produire des résultats. Et que, pour comparer vos chiffres de cette année, à ceux de l’année dernière… il faut au moins 1 an d’historique dans vos données. Damned. Ces solutions n’apporteront pas de réponses magiques overnight. L’an prochain, peut-être. Au mieux. Et d’ici là, vous allez devoir dresser la machine pour qu’elle apprenne que les soldes, les fêtes de fin d’année et la St Valentin sont des anomalies… normales :)

Reprenez le contrôle de vos données !

Nous sommes en 2017. Le marketing est définitivement Data Driven. Les expériences qu’attendent vos clients et vos consommateurs sont également construites sur des Insights qui sont tirés de l’analyse de données.

Reprenez le contrôle de vos données. L’investissement dans des solutions de pointe ne dispense en aucun cas d’investir dans des collaborateurs ou des partenaires qui pourront vous accompagner et sauront en tirer toute la valeur.

Faites-vous aider. Ces investissements sont payants.

Sur le même thème : “Le père de Siri et celui de M for Messenger dézinguent la hype autour de l’intelligence artificielle”

“Le Forum Netexplo 2017 avait réuni deux intervenants de choix pour discuter d’intelligence artificielle : Luc Julia, père de Siri et désormais VP de l’innovation chez Samsung, et Alexandre Lebrun, qui dirige le développement de l’intelligence artificielle pour l’assistant personnel de Facebook, M for Messenger. Les deux experts ont parlé sans retenue de leur discipline, touchant aussi bien aux défis qu’il reste à conquérir qu’aux idées reçues tout en démystifiant la technologie. Compte rendu (…)”

Lien : http://www.usine-digitale.fr/article/le-pere-de-siri-et-celui-de-m-for-messenger-dezinguent-la-hype-autour-de-l-intelligence-artificielle.N532799